Dietro le quinte del GFS: come nasce la previsione meteo

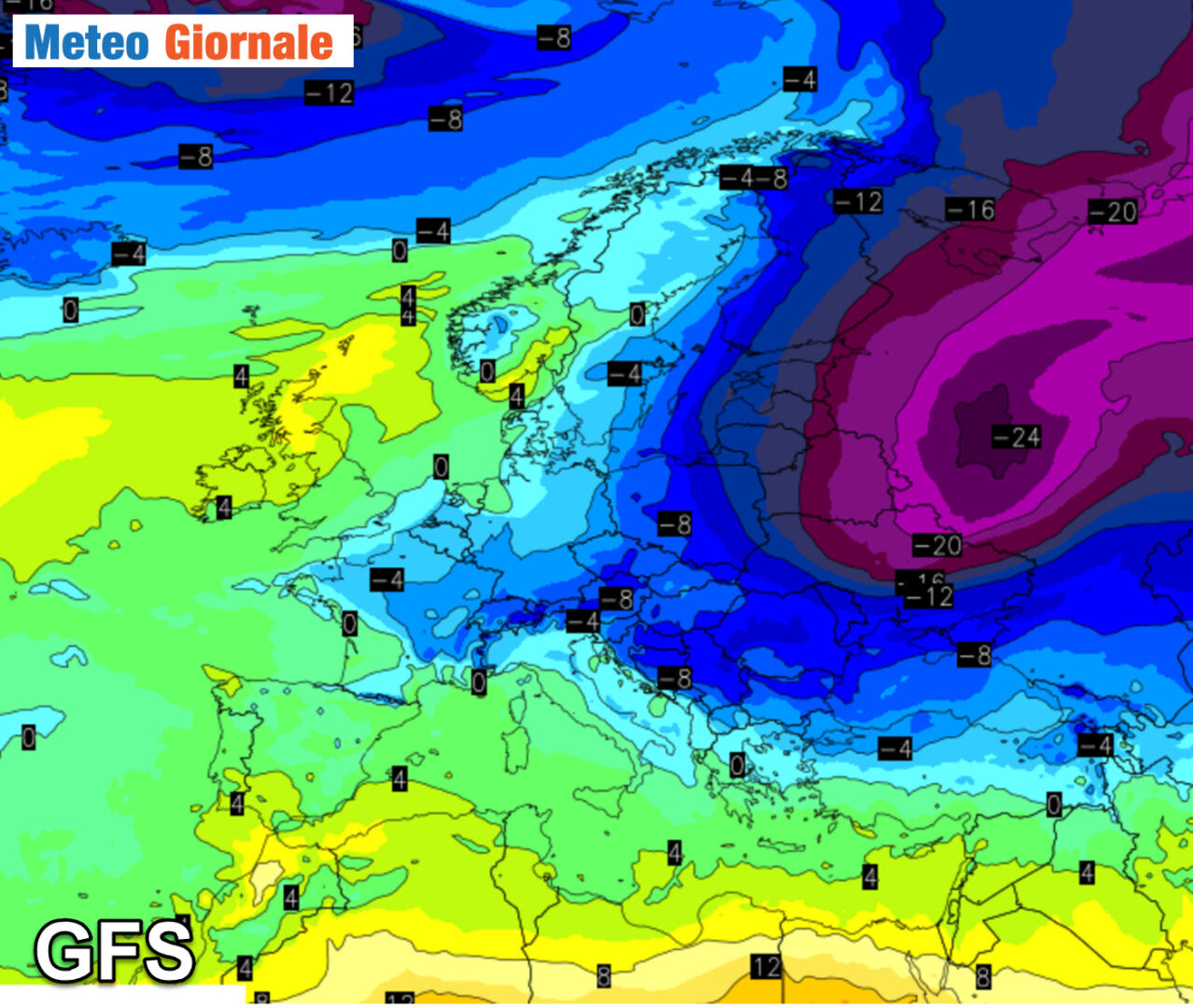

(METEOGIORNALE.IT) Se c’è una sigla che fa tremare i polsi o accendere le speranze degli appassionati di meteorologia, quella è senza dubbio GFS. Parliamo del Global Forecast System, il cavallo di battaglia del National Centers for Environmental Prediction (NCEP), una branca della NOAA. Insomma, il “modello americano” per eccellenza. Ma vi siete mai chiesti cosa accade davvero dentro quei supercomputer negli Stati Uniti? Non è magia, è matematica pura – e una dose massiccia di fisica – che viene macinata quattro volte al giorno per dirci se domani pioverà a Roma o se farà freddo a Milano.

Differenze sostanziali

Quando apriamo una qualsiasi app meteo o guardiamo le mappe colorate sul web, spesso ci troviamo davanti al risultato del cosiddetto “run ufficiale”. Diciamolo, è la star dello spettacolo. Si tratta della corsa deterministica, ovvero un’unica simulazione ad altissima risoluzione che prende i dati iniziali dell’atmosfera e calcola come evolveranno nel tempo. È preciso, dettagliato, ma ha un difetto enorme: basta un errore infinitesimale nei dati di partenza – magari una lettura sbagliata di un pallone sonda sopra il Pacifico – e la previsione a 10 giorni può prendere una cantonata clamorosa.

Ed è qui che entra in gioco la vera potenza di fuoco del centro meteo americano: le GEFS, ovvero il Global Ensemble Forecast System. Immaginatele come un coro che accompagna il solista. Invece di fare un solo calcolo, il sistema ne lancia altri 30 (più il run di controllo). Ognuno di questi trenta “membri” parte da una situazione iniziale leggermente modificata, “perturbata” direbbero i tecnici.

Perché lo fanno? Semplice. Se tutte e 30 le linee di tendenza – i famosi “spaghetti” che vediamo nei grafici – finiscono nello stesso punto, possiamo stare tranquilli: la previsione è solida. Se invece ognuno va per la sua strada, beh, l’affidabilità crolla vertiginosamente. In effetti, guardare solo il run ufficiale senza consultare le ensemble è un po’ come tirare una monetina sperando che esca testa.

Una maratona che non finisce mai

Il ciclo di vita di questi dati è frenetico, quasi ansiogeno se ci pensate. Tutto si ripete ogni sei ore, cascasse il mondo. Gli orari sono sacri e seguono il tempo coordinato universale: 00z, 06z, 12z e 18z. Mentre noi in Europa magari dormiamo o siamo in pausa pranzo, i server della NOAA stanno ingurgitando terabyte di dati provenienti da satelliti, aerei di linea, boe oceaniche e stazioni di terra.

Il processo è affascinante nella sua complessità. Prima c’è l’assimilazione dati, una fase critica dove il modello cerca di costruire una fotografia coerente dello stato attuale dell’atmosfera. Poi parte l’integrazione numerica. Il modello matematico risolve equazioni differenziali complesse su una griglia tridimensionale che avvolge l’intero globo. Fino a qualche anno fa la risoluzione era grossolana, ma oggi il GFS lavora con una griglia molto fitta, scendendo a circa 13 chilometri per il run deterministico. Le ensemble, per risparmiare tempo e risorse – che non sono infinite nemmeno per gli americani – girano a una risoluzione leggermente inferiore.

Come si arriva al gran finale

Il risultato finale non è un semplice “domani piove”. È un pacchetto mostruoso di variabili: temperatura a 2 metri, geopotenziale a 500 hPa, venti stratosferici, umidità relativa e chi più ne ha più ne metta. Questi dati grezzi vengono poi “post-processati” per essere leggibili dai meteorologi e, in ultima analisi, dalle app che avete sul telefono.

C’è però un dettaglio che spesso sfugge. Il modello americano GFS ha una caratteristica che lo rende unico rispetto, ad esempio, al collega europeo ECMWF (il prestigioso centro di Reading): è completamente open source. Chiunque, dal ricercatore universitario in Giappone all’appassionato in Sud America, può scaricare i dati gratuitamente appena vengono sfornati. Questa trasparenza ha reso il GFS il modello più diffuso al mondo, anche se – va detto per onestà intellettuale – in termini di pura performance statistica, il modello europeo tende ancora ad avere una marcia in più, specialmente nell’emisfero settentrionale.

Tuttavia, il GFS ha fatto passi da gigante. Con l’introduzione del nuovo nucleo dinamico FV3 (Finite-Volume Cubed-Sphere) qualche anno fa, la gestione dei fenomeni complessi come gli uragani nell’Atlantico o le ondate di gelo come il Vortice Polare è migliorata sensibilmente. Insomma, non è perfetto, ma è uno strumento formidabile che ogni sei ore ci prova, instancabilmente, a mettere ordine nel caos dell’atmosfera.

Fonti e approfondimenti internazionali:

- NOAA National Centers for Environmental Prediction (NCEP) – Il centro operativo che sviluppa e gestisce il modello GFS.

- NOAA Physical Sciences Laboratory – Dati storici e dettagli tecnici sulle reanalisi e le previsioni globali.

- UCAR – University Corporation for Atmospheric Research – Consorzio che offre approfondimenti scientifici sui modelli atmosferici e la ricerca meteorologica.

- WMO – World Meteorological Organization – L’agenzia delle Nazioni Unite che coordina gli standard meteorologici globali.

- American Meteorological Society (AMS) Journals – Pubblicazioni scientifiche peer-reviewed riguardanti gli avanzamenti nella modellistica numerica.